O Custo Oculto das Ferramentas de IA: Riscos de Privacidade de Dados que Toda Empresa no Brasil Precisa Conhecer

Descubra os perigos da "IA Sombra" e vazamento de dados em empresas brasileiras. Aprenda a proteger informações sensíveis e garantir a conformidade regulatória com nossa checklist de governança de IA.

No último trimestre, uma empresa da Fortune 500 descobriu que três equipes de engenharia diferentes estavam colando código-fonte proprietário no ChatGPT por meses. O código incluía lógica de autenticação, chaves de API (sim, reais) e documentação de arquitetura interna. Ninguém lhes disse para fazer isso — eles simplesmente começaram a usar porque os tornava mais rápidos. E ninguém da segurança ou TI sabia que isso estava acontecendo.

Esta não é uma história de terror hipotética. Eu vi variações disso acontecer em sete organizações diferentes no último ano. Os detalhes mudam, mas o padrão é sempre o mesmo: funcionários acham as ferramentas de IA úteis, começam a usá-las sem aprovação, e dados sensíveis fluem para servidores de terceiros sem que ninguém perceba até que seja tarde demais.

Os ganhos de produtividade das ferramentas de IA são reais. Mas os riscos também são. E a maioria das organizações está completamente despreparada para eles.

O Problema da IA Sombra É Maior do que Você Pensa

De acordo com uma pesquisa de 2026 da Gartner, 68% dos funcionários em organizações empresariais usam ferramentas de IA que não foram verificadas ou aprovadas pelo departamento de TI. Deixe esse número afundar. Mais de dois terços da sua força de trabalho está potencialmente compartilhando dados da empresa com serviços externos de IA.

E não é apenas o ChatGPT. O cenário da IA sombra inclui:

- Assistentes de codificação de IA — desenvolvedores colando código em várias ferramentas de IA para depuração e geração de código

- Ferramentas de escrita de IA — equipes de marketing usando IA para refinar mensagens que incluem detalhes de produtos não lançados

- Assistentes de reunião de IA — gravando e transcrevendo chamadas confidenciais de clientes sem consentimento explícito

- Ferramentas de e-mail de IA — plugins de IA processando threads de e-mail internos para rascunhar respostas

- Ferramentas de análise de dados de IA — analistas carregando planilhas contendo PII de clientes para serviços de IA baseados na web

- Geradores de imagem de IA — equipes de design carregando mockups proprietários e ativos de marca

A causa raiz não é malícia — é conveniência. Essas ferramentas realmente tornam as pessoas mais produtivas, e quando um funcionário enfrenta a escolha entre "fazer o relatório em 30 minutos com IA" ou "passar 3 horas fazendo manualmente porque a TI ainda não aprovou nada", eles escolhem a opção rápida. Sempre.

Quais Dados Estão Realmente em Risco?

Quando falamos de "vazamento de dados" através de ferramentas de IA, vamos ser específicos sobre quais tipos de dados estão fluindo para servidores externos:

1. Código-Fonte e Arquitetura Técnica

Desenvolvedores copiam e colam código em assistentes de IA para depuração, otimização e revisão de código. Esse código pode incluir algoritmos proprietários, implementações de segurança, esquemas de banco de dados e configurações de infraestrutura. Em um caso que conheço, um desenvolvedor colou um microsserviço inteiro (incluindo credenciais codificadas) em um chatbot de IA para pedir uma revisão de código.

O risco não é apenas que a empresa de IA veja seu código. Muitos provedores de IA usam interações de clientes para treinar seus modelos (a menos que você tenha explicitamente optado por não participar). Seu código proprietário poderia teoricamente influenciar as sugestões do modelo para outros usuários, incluindo concorrentes.

2. PII de Clientes e Dados Financeiros

Quando analistas carregam planilhas para ferramentas de IA para análise, essas planilhas geralmente contêm nomes de clientes, endereços de e-mail, números de telefone, históricos de transações e saldos de contas. Mesmo que a tarefa de análise seja legítima ("resumir tendências nesses dados"), a transferência de dados pode violar acordos de processamento de dados, políticas de privacidade e regulamentações.

Eu vi um caso em que uma equipe de suporte ao cliente estava colando tickets de suporte inteiros — incluindo nomes de clientes, números de conta e detalhes de reclamações — no ChatGPT para rascunhar respostas. As respostas eram boas. A equipe de conformidade com a LGPD não ficou nada satisfeita.

3. Informações Estratégicas e Financeiras

Executivos e equipes de estratégia usam IA para analisar cenários competitivos, refinar documentos de fusões e aquisições, rascunhar apresentações para o conselho e modelar cenários financeiros. Essas informações são frequentemente informações materiais não públicas (MNPI) que, se vazadas, podem criar violações da lei de valores mobiliários sob a SOX e outras regulamentações.

4. Documentos de Clientes e Jurídicos

Escritórios de advocacia e empresas de consultoria foram pegos enviando documentos de clientes através de ferramentas de IA para sumarização e análise. Além das preocupações com a privacidade dos dados, isso potencialmente viola o sigilo advogado-cliente e acordos de confidencialidade do cliente.

5. Dados de RH e Funcionários

Equipes de RH usaram ferramentas de IA para rascunhar avaliações de desempenho, analisar dados de compensação e até mesmo rastrear currículos. Esses dados incluem informações protegidas sob a legislação trabalhista, e processá-los através de serviços de IA não aprovados pode criar exposição legal.

O Cenário Regulatório: Está Mais Rígido

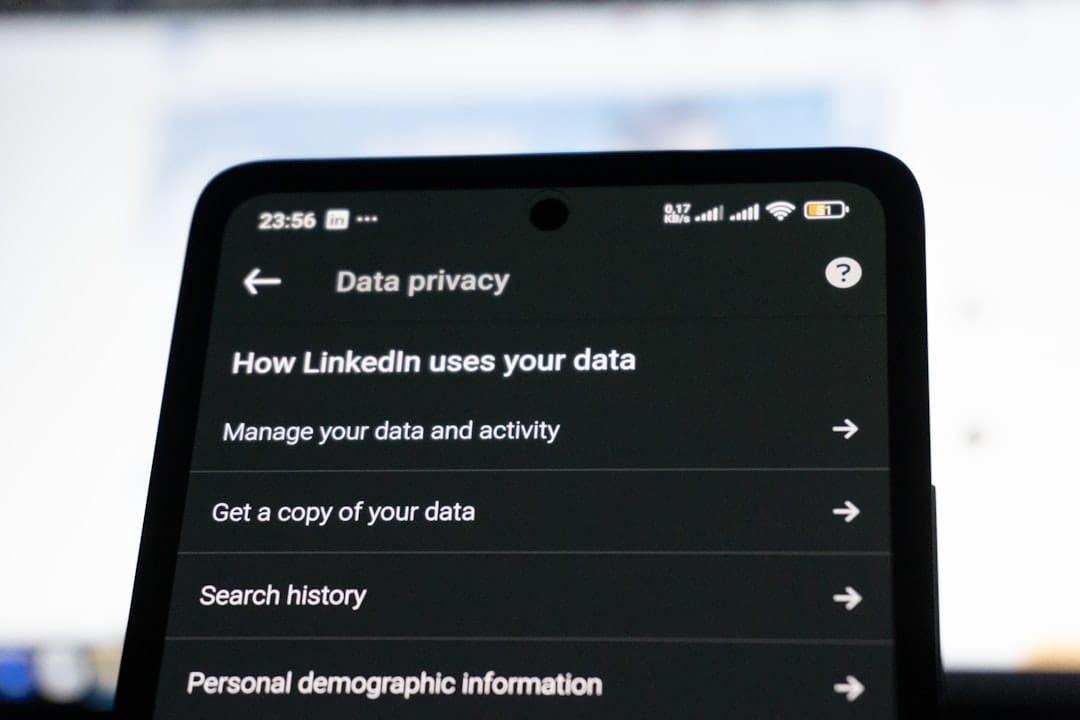

LGPD (Brasil)

Sob a LGPD, enviar dados pessoais para um serviço de IA constitui processamento de dados. Você precisa de uma base legal, um contrato de processamento de dados com o provedor de IA e (dependendo de onde o provedor de IA armazena os dados) salvaguardas apropriadas para a transferência de dados. A maioria do uso de IA sombra viola todos os três requisitos.

As penalidades não são teóricas. Em 2025, uma empresa italiana foi multada em EUR 2,1 milhões (cerca de R$ 12 milhões) por usar uma ferramenta de IA para processar dados de desempenho de funcionários sem uma Avaliação de Impacto à Proteção de Dados (DPIA) adequada. A ferramenta de IA em si não era o problema — a falta de governança em torno de seu uso era.

SOX (Empresas Públicas dos EUA)

A SOX exige que as empresas mantenham controles sobre os processos de relatórios financeiros. Se os funcionários estão usando ferramentas de IA não aprovadas para processar dados financeiros, analisar números de receita ou rascunhar demonstrações financeiras, essas ferramentas de IA se tornam parte da cadeia de relatórios financeiros — e não passaram pelo processo de avaliação de controle da SOX.

Um auditor perguntando "algum software não aprovado foi usado na preparação dessas demonstrações financeiras?" é uma pergunta que a maioria das empresas não está preparada para responder honestamente.

HIPAA (Saúde)

Organizações de saúde precisam de Business Associate Agreements (BAAs) com qualquer serviço que processe Informações de Saúde Protegidas (PHI). A maioria das ferramentas de IA de consumo não oferece BAAs, tornando qualquer uso dessas ferramentas com dados de pacientes uma violação da HIPAA. Ponto final.

Regulamentações Específicas da Indústria

Serviços financeiros (FINRA, SEC), defesa (ITAR, CMMC) e governo (FedRAMP) todos têm requisitos específicos sobre manuseio de dados que o uso de IA sombra quase certamente viola. O ambiente regulatório está se tornando mais rígido, não mais flexível — a Lei de IA da UE, em vigor desde 2025, adiciona outra camada de requisitos em torno da documentação de uso de IA e avaliação de risco.

Vazamento de Dados: Como Realmente Acontece

Deixe-me detalhar os mecanismos técnicos, porque entender como os dados vazam através de ferramentas de IA é essencial para preveni-lo.

Inclusão de Dados de Treinamento

Quando você usa um serviço de IA, sua entrada pode ser usada para melhorar o modelo. A política padrão do OpenAI para contas de consumidor do ChatGPT permite o treinamento em entradas do usuário (você pode optar por não participar nas configurações, mas a maioria das pessoas não o faz). Isso significa que qualquer coisa que você digite pode influenciar o comportamento futuro do modelo. Embora o risco de sua entrada exata ser regurgitada seja baixo, não é zero — houve casos documentados de modelos de IA reproduzindo dados de treinamento, incluindo informações pessoais.

Planos de API empresariais geralmente não usam seus dados para treinamento, mas as versões de consumidor (que é o que os usuários de IA sombra estão usando) muitas vezes o fazem. Essa distinção importa enormemente.

Retenção de Dados no Servidor

Mesmo que seus dados não sejam usados para treinamento, eles são armazenados nos servidores do provedor por algum período de retenção. Isso cria uma superfície de risco: violações de servidor, ameaças internas na empresa de IA ou intimações legais podem expor seus dados. Você está essencialmente estendendo sua superfície de ataque para incluir cada provedor de IA que seus funcionários usam.

Extensões e Plugins de Navegador

Muitas ferramentas de IA operam como extensões de navegador que têm amplas permissões. Um "útil" assistente de e-mail de IA pode ter acesso para ler todo o conteúdo do seu e-mail. Um plugin de sumarização de IA pode capturar o conteúdo de cada página da web que você visita. O modelo de permissões para extensões de navegador é grosseiro — você concede acesso ou não, e a extensão muitas vezes obtém muito mais acesso do que precisa para sua função declarada.

Exposição de Chaves de API e Credenciais

Desenvolvedores colando código em ferramentas de IA às vezes incluem credenciais, chaves de API, strings de conexão ou tokens. Mesmo que o provedor de IA seja confiável, essas credenciais estão agora fora do seu perímetro de segurança. E os históricos de bate-papo de IA podem ser comprometidos através de ataques de tomada de conta na conta de serviço de IA do desenvolvedor.

Bloqueio de Fornecedor (Vendor Lock-in): O Risco Que Ninguém Fala

Aqui está um risco que é menos dramático do que o vazamento de dados, mas potencialmente mais caro: o bloqueio de fornecedor (vendor lock-in) com serviços de IA.

Quando sua equipe constrói fluxos de trabalho que dependem de um modelo ou serviço de IA específico, você cria uma dependência. Se esse serviço mudar seus preços (o que já aconteceu várias vezes), mudar seus termos de serviço (também aconteceu) ou degradar em qualidade (acontece regularmente após atualizações de modelo), você está preso.

Eu vi organizações construir processos de negócios críticos em torno de capacidades específicas de IA — geração automatizada de relatórios, rascunho de comunicação com clientes, pipelines de transformação de dados — apenas para o provedor de IA mudar o comportamento do modelo em uma atualização, quebrando o fluxo de trabalho. Ao contrário do software tradicional onde você controla quando atualizar, as atualizações de modelo de IA acontecem no cronograma do provedor.

A mitigação é arquitetônica: projete suas integrações de IA com camadas de abstração para que você possa trocar de provedores sem reescrever tudo. Mas a maioria das organizações pula isso porque está com pressa para obter valor da IA, e o custo de troca se acumula ao longo do tempo.

Avaliação de Risco: Quão Exposta Está Sua Organização?

Aqui está uma tabela rápida de avaliação de risco. Avalie sua organização honestamente:

| Fator de Risco | Baixo Risco (1) | Médio Risco (3) | Alto Risco (5) |

|---|---|---|---|

| Uso de IA Sombra | Ferramentas aprovadas pela TI apenas, impostas via DLP | Algumas ferramentas aprovadas, aplicação limitada | Nenhuma política ou política não aplicada |

| Classificação de Dados | Classificação madura com marcação automatizada | Classificação manual, inconsistente | Nenhum sistema de classificação |

| Políticas Específicas de IA | Política de uso aceitável detalhada, atualizada regularmente | Política geral de TI menciona IA | Nenhuma política específica de IA |

| Treinamento/Conscientização | Treinamento regular de privacidade de IA para todos os funcionários | Treinamento único, não específico de IA | Nenhum treinamento |

| Avaliação de Fornecedores | Fornecedores de IA avaliados quanto ao manuseio de dados, DPAs assinados | Alguns fornecedores avaliados | Nenhuma avaliação de fornecedores de IA |

| Monitoramento | Ferramentas DLP monitoram uploads de dados para ferramentas de IA | Monitoramento de rede, sem regras específicas de IA | Nenhum monitoramento |

| Resposta a Incidentes | Vazamento de dados de IA no playbook de IR | Plano geral de IR de violação de dados | Nenhum plano de IR para incidentes de IA |

| Conformidade Regulatória | Uso de IA documentado para auditores | Parcialmente documentado | Nenhuma documentação |

Pontuação 8-16: Você está à frente da maioria das organizações. Concentre-se na melhoria contínua e em se manter atualizado com as mudanças regulatórias.

Pontuação 17-28: Lacunas significativas existem. Priorize os itens com pontuação 3 ou superior.

Pontuação 29-40: Risco crítico. Você provavelmente já tem exposição de dados da qual não tem conhecimento. Ação imediata é necessária.

Na minha experiência, a maioria das organizações que avaliei pontua entre 25 e 35. A lacuna entre "sabemos que a privacidade da IA é importante" e "realmente fizemos algo a respeito" é enorme.

A Checklist de Governança de IA de 10 Pontos

Aqui está uma estrutura de governança prática e acionável. Implementei variações disso em várias organizações, e funciona porque equilibra segurança com usabilidade. Se você tornar a IA muito difícil de usar, as pessoas simplesmente voltam para a IA sombra.

1. Crie um Registro de Ferramentas de IA Aprovadas

Mantenha uma lista de ferramentas de IA que foram verificadas por segurança, jurídico e compras. Para cada ferramenta, documente: quais tipos de dados são aprovados para uso com ela, quais são as políticas de retenção e treinamento de dados e quem é o proprietário do negócio. Torne esta lista facilmente acessível — se as pessoas não conseguirem encontrar as alternativas aprovadas, elas usarão o que aparecer primeiro no Google.

2. Implemente a Classificação de Dados para o Contexto de IA

Seu esquema de classificação de dados existente (você tem um, certo?) precisa de uma dimensão específica de IA. Nem todos os dados confidenciais são iguais quando se trata de risco de IA. Um rascunho de estratégia de marketing é confidencial, mas de baixo risco para processamento de IA. CPFs de clientes são confidenciais e de risco extremamente alto. Crie categorias claras: "seguro para IA", "restrito para IA" (somente ferramentas aprovadas) e "proibido para IA" (nenhum processamento de IA, ponto final).

3. Implante Regras de DLP para Serviços de IA

Configure suas ferramentas de Prevenção de Perda de Dados (DLP) para detectar e bloquear o envio de dados sensíveis para domínios de serviços de IA conhecidos. Isso inclui endpoints de API para os principais provedores de IA, aplicativos web de IA populares e canais de dados de extensão de navegador. Não pegará tudo (VPNs e dispositivos pessoais são um desafio), mas pega o que é mais fácil e envia um sinal claro sobre a aplicação da política.

4. Negocie Acordos Empresariais com Provedores de IA

Passe de contas de consumidor para acordos empresariais. Planos empresariais da OpenAI, Anthropic, Google e outros incluem compromissos contratuais sobre o manuseio de dados: nenhum treinamento em seus dados, períodos de retenção específicos, direitos de auditoria e adendos de processamento de dados que satisfazem a LGPD e outros requisitos. O custo premium quase sempre vale a redução de risco.

5. Exija Treinamento de Uso de IA (Anualmente)

Treinamento anual que abrange: quais tipos de dados podem e não podem ser usados com ferramentas de IA, como usar ferramentas aprovadas corretamente (incluindo optar por não usar dados de treinamento em contas pessoais), como reconhecer e relatar incidentes de dados relacionados à IA e quais são as consequências das violações de política. Mantenha-o abaixo de 30 minutos — ninguém presta atenção a treinamentos de conformidade de uma hora.

6. Estabeleça um Playbook de Resposta a Incidentes de IA

Seu plano de resposta a incidentes existente provavelmente não cobre "desenvolvedor colou credenciais de banco de dados de produção no ChatGPT". Crie runbooks específicos para cenários comuns de exposição de dados de IA: credenciais expostas via IA, PII processados por IA não aprovada, dados confidenciais de clientes enviados para serviços de IA e conteúdo gerado por IA contendo informações confidenciais alucinadas, mas plausíveis (sim, este é um cenário real).

7. Conduza Auditorias Trimestrais de Uso de IA

Realize auditorias trimestrais que incluem: análise de tráfego de rede para domínios de serviço de IA, pesquisa de equipes sobre o uso de ferramentas de IA (ofereça anistia para respostas honestas na primeira rodada), revisão de logs de acesso a ferramentas de IA e faturamento (cobranças inesperadas em cartões corporativos podem revelar IA sombra) e verificações pontuais de históricos de conversas de IA em plataformas aprovadas.

8. Implemente o Monitoramento do Uso de IA (Não Vigilância)

Há uma diferença entre monitorar vazamento de dados e vigiar a produtividade dos funcionários. Concentre-se em detectar padrões de dados sensíveis sendo enviados para serviços externos de IA, não em rastrear quanto tempo as pessoas gastam usando IA. Enquadre-o como "estamos protegendo os dados da empresa", não "estamos observando o que você faz". A distinção importa para a confiança dos funcionários e, em muitas jurisdições, para a conformidade legal com as leis de monitoramento no local de trabalho.

9. Crie um Comitê de Ética e Risco de IA

Este não deve ser mais um comitê de governança sem dentes. Inclua: um líder de segurança/privacidade (presidente), representante jurídico/conformidade, representantes de unidades de negócios que realmente usam IA diariamente e liderança de TI/engenharia. Reúna-se mensalmente. Revise novas ferramentas de IA para aprovação, avalie incidentes e atualize políticas com base no cenário regulatório em evolução. Dê ao comitê autoridade real para bloquear implantações que não atendam aos padrões.

10. Documente Tudo para Reguladores

Mantenha a documentação de: quais ferramentas de IA são aprovadas e por quê, quais dados são processados por cada ferramenta de IA, avaliações de risco realizadas para cada implantação de IA, registros de treinamento para todos os funcionários, logs de incidentes e ações de remediação, e avaliações de fornecedores e acordos de processamento de dados. Esta documentação não é opcional — é o que o salva em uma auditoria ou investigação. O Artigo 30 da LGPD, a Seção 404 da SOX e regulamentações semelhantes exigem evidências demonstráveis de governança, não apenas políticas que existem no papel.

Implementação no Mundo Real: O Que Realmente Funciona

Ajudei a implementar a governança de IA em quatro organizações que variam de 200 a 5.000 funcionários. Aqui está o que aprendi sobre o que realmente funciona versus o que parece bom em um PowerPoint:

Torne as ferramentas aprovadas melhores do que a IA sombra. A coisa mais eficaz que você pode fazer é fornecer ferramentas de IA que sejam tão boas ou melhores do que as que os funcionários encontram por conta própria, com segurança já incorporada. Se seu assistente de codificação de IA aprovado for pior do que o ChatGPT gratuito, os desenvolvedores usarão o ChatGPT. Ponto final. Invista em boas ferramentas de IA empresariais.

Comece com educação, não com imposição. Em uma organização, começamos bloqueando sites de IA no firewall. Reclamações de produtividade chegaram à mesa do CEO em uma semana, e os bloqueios foram revertidos. Em outra, começamos com uma campanha de educação em toda a empresa explicando os riscos, fornecendo alternativas aprovadas e dando às pessoas 30 dias para migrar. A conformidade foi de 85% em um mês. As pessoas não são estúpidas — elas simplesmente não sabiam os riscos.

Aceite que o controle total é impossível. Celulares pessoais, notebooks pessoais em casa e Wi-Fi externo significam que você nunca controlará totalmente quais ferramentas de IA as pessoas usam fora do escritório. Seu objetivo é minimizar o uso de IA sombra e garantir que, quando isso acontecer, os dados expostos sejam de baixo risco. A classificação de dados é sua amiga aqui.

Torne a denúncia segura. Os funcionários não denunciarão que acidentalmente colaram dados de clientes no ChatGPT se acharem que serão demitidos. Crie um porto seguro para denunciar incidentes de dados relacionados à IA dentro de 24 horas. O custo de não saber sobre um incidente é sempre maior do que o custo de perdoar a pessoa que o denunciou.

O Custo de Fazer Isso Errado

Deixe-me pintar um quadro do que uma má governança de IA custa:

- Multas regulatórias: Multas da LGPD de até 2% do faturamento da empresa no Brasil, limitado a R$ 50 milhões por infração. Uma única violação de dados relacionada à IA pode desencadear investigações.

- Responsabilidade legal: Se dados confidenciais de clientes forem expostos através do uso de IA por um funcionário, espere processos judiciais e rescisões de contrato.

- Dano competitivo: Se algoritmos proprietários ou planos estratégicos vazarem através de dados de treinamento de IA, o impacto competitivo é inquantificável.

- Dano à reputação: "Empresa X vazou dados de clientes através de chatbot de IA" é uma manchete que nenhuma equipe de RP pode girar positivamente.

- Custos de remediação: Rotacionar todas as credenciais que podem ter sido coladas em uma ferramenta de IA, notificar os clientes afetados e contratar investigadores forenses externos. Uma organização que conheço gastou R$ 1,7 milhão (aproximadamente US$ 340.000) em remediação após descobrir um ano de uso de IA sombra.

Olhando para o Futuro

O cenário de privacidade da IA está evoluindo rapidamente. Algumas tendências a serem observadas:

Implantações de IA on-premises e privadas estão se tornando mais práticas. Executar sua própria instância de LLM (via serviços como Azure OpenAI, AWS Bedrock ou modelos de código aberto como Llama) mantém seus dados dentro do seu perímetro de segurança. A lacuna de qualidade entre modelos hospedados e auto-hospedados está diminuindo rapidamente.

Ferramentas DLP específicas para IA estão surgindo. Produtos de empresas como Nightfall, Protect AI e outras são especificamente projetados para monitorar e controlar o fluxo de dados para serviços de IA. Estes são mais eficazes do que reutilizar regras DLP tradicionais.

A clareza regulatória está chegando. A Lei de IA da UE, o Framework de Gerenciamento de Risco de IA do NIST e regulamentações semelhantes eventualmente resolverão a ambiguidade em torno dos requisitos de processamento de dados de IA. Até então, prepare-se em excesso, em vez de se preparar de menos.

Provedores de IA estão melhorando suas ofertas empresariais. O nível Enterprise da OpenAI, o Claude for Business da Anthropic e o Vertex AI do Google oferecem governança de dados mais forte do que seus produtos de consumo. À medida que estes amadurecem, a lacuna entre "IA segura" e "IA conveniente" diminuirá.

A conclusão: as ferramentas de IA são muito valiosas para proibir e muito arriscadas para ignorar. As organizações que prosperarão são aquelas que descobrem a governança cedo — não como uma forma de restringir o uso de IA, mas como uma forma de habilitá-la com segurança. Seus funcionários usarão IA, quer você tenha uma política ou não. É melhor ter uma política que facilite o uso seguro do que nenhuma política que torne o uso inseguro inevitável.